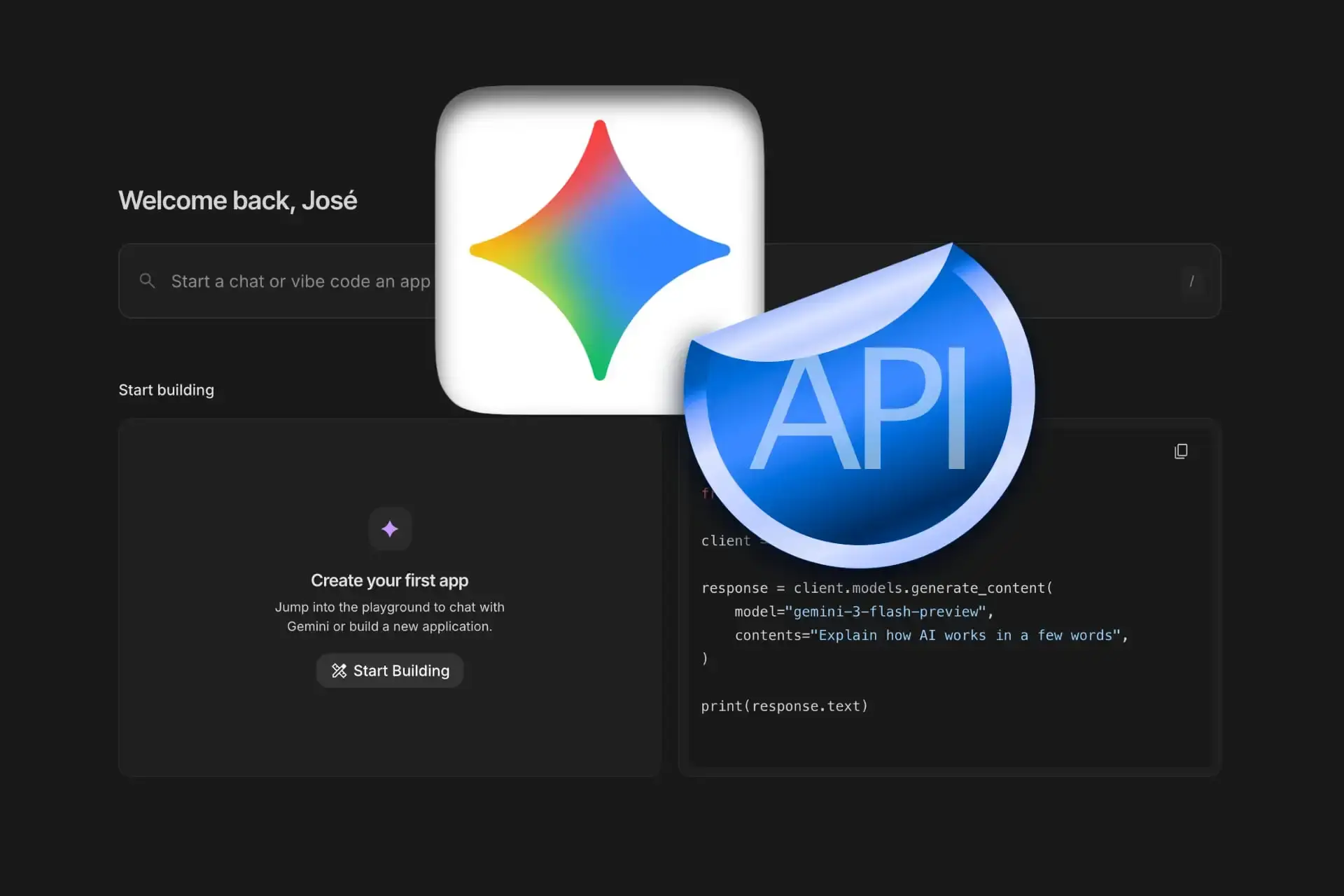

- La API gratis de Gemini permite integrar la IA de Google en apps, bots y flujos de trabajo respetando límites de solicitudes y tokens.

- Google AI Studio es la vía más rápida para generar una clave API, mientras que Google Cloud añade control avanzado y otros servicios gratuitos.

- Plataformas de terceros simplifican el uso de Gemini junto a otros modelos, pero exigen cuidar la privacidad y el tratamiento de datos.

- El ecosistema de herramientas y niveles sin coste de Google facilita a desarrolladores y freelancers crear soluciones de IA sin inversión inicial.

Si has llegado hasta aquí es porque quieres saber cómo conseguir y aprovechar una API gratis de Gemini sin liarte con docenas de paneles, cuotas y condiciones raras. La buena noticia es que Google está empujando muy fuerte su ecosistema de IA y hoy en día es posible usar Gemini en tus proyectos sin pagar un euro, siempre que respetes ciertos límites.

En las próximas líneas vas a encontrar una guía muy completa sobre qué es exactamente la API de Gemini, cómo funciona su nivel gratuito, qué modelos incluye, qué límites tiene y cómo generar tu clave paso a paso tanto desde Google AI Studio como desde Google Cloud y plataformas de terceros. También veremos temas delicados como la privacidad de los datos cuando usas intermediarios, y algunos trucos para estirar al máximo la cuota gratuita.

Qué es Gemini y qué significa tener una API gratis

Gemini es el nombre que Google da tanto a su modelo de inteligencia artificial generativa como al chat que tú ves en pantalla cuando hablas con la IA. Por debajo del chatbot hay un motor que es capaz de procesar texto, imágenes, audio y vídeo, razonar sobre ellos y devolverte respuestas útiles; ese motor es el que se expone a través de la API.

Cuando hablamos de API (Interfaz de Programación de Aplicaciones) nos referimos a un puente de comunicación entre tu aplicación y los servidores de Google. En lugar de descargar un modelo que puede pesar gigas o teras e instalarlo en tu máquina, tu app manda la petición a la API de Gemini, Google procesa la solicitud en su infraestructura y te devuelve la respuesta en tiempo real.

Disponer de una API de Gemini te permite integrar el modelo en bots, webs, automatizaciones y servicios propios sin que el usuario final tenga por qué saber que por detrás está Gemini. Tu app envía un prompt, la API responde con texto, código, JSON estructurado o incluso referencias a imágenes y audio, y tú decides cómo presentar ese resultado.

La gracia del nivel gratuito está en que Google ofrece un uso sin coste de varios modelos Gemini con límites de velocidad y de tokens. Por ejemplo, para Gemini 2.5 Pro se manejan cifras como 5 solicitudes por minuto o unas 100 solicitudes al día, mientras que otros modelos como Gemini 3 Flash o variantes Flash Lite tienen límites propios de solicitudes por minuto (RPM), tokens por minuto (TPM) y solicitudes diarias (RPD).

En paralelo, Google mantiene otros productos cloud con niveles gratuitos permanentes (traducción, texto a voz, reconocimiento de imágenes o vídeo, etc.) con cuotas mensuales que no caducan (caracteres, minutos, unidades de análisis). Esto hace que puedas montar soluciones bastante serias combinando la API de Gemini con otros servicios gratis de Google Cloud.

Para qué sirve la API de Gemini en la práctica

Una vez tienes tu clave, puedes utilizar la API gratis de Gemini como pieza central de todo tipo de proyectos. No se trata solo de chatear, sino de orquestar workflows completos donde Gemini se convierte en el “cerebro” de tu sistema.

Un uso típico es crear chatbots y asistentes conversacionales para soporte al cliente, atención interna o ayuda contextual dentro de una web o aplicación móvil. Tu bot recibe la pregunta del usuario, la manda a la API de Gemini con algo de contexto (por ejemplo, la documentación de tu producto) y la respuesta vuelve lista para mostrarse.

Otro escenario muy habitual es el análisis y transformación de contenido: transcribir audios y vídeos, resumir documentos largos, reescribir textos en otros tonos, generar descripciones de productos o clasificar contenidos. Al trabajar con tokens, Gemini puede manejar grandes volúmenes de texto, especialmente en versiones como Gemini 2.5 Pro con ventanas de contexto enormes.

La API también se usa mucho para tareas de generación y ayuda al desarrollo de código. Desde Google Code Assist, que integra modelos Gemini directamente en IDEs como VS Code o JetBrains, hasta asistentes personalizados que revisan tu base de código, proponen refactorizaciones o generan tests de manera automática.

En el terreno de la productividad, Gemini se conecta con flujos de trabajo y servicios externos como Gmail, herramientas de mensajería o CRM, donde la IA se encarga de redactar respuestas, crear resúmenes de reuniones, clasificar correos o disparar automatizaciones. La API es la pieza que permite que tu sistema llame a Gemini en segundo plano cuando toca.

Por último, el enfoque multimodal permite combinar texto, imágenes, audio y vídeo en una misma interacción. Puedes subir una imagen y pedir un análisis, generar código que procese ese resultado o incluso construir asistentes especializados en trabajar con documentos visuales, todo orquestado a través de la misma API.

Modelos disponibles y límites de la API gratuita

Dentro del nivel sin coste, Google permite acceder a varios modelos de su familia Gemini, con distintas capacidades y cuotas. Entre los más destacados que se mencionan en la documentación y el ecosistema actual están Gemini 2.5 Pro, Gemini 3 Flash y variantes anteriores de Flash y Flash Lite.

Gemini 2.5 Pro es el modelo más avanzado y orientado a razonamiento complejo, con una ventana de contexto que puede llegar al millón de tokens, razonamiento “simulado” para validar sus propias respuestas y soporte multimodal completo (texto, imágenes, audio, vídeo y código). Es el candidato natural si necesitas calidad máxima y contextos muy largos.

Gemini 3 Flash y los modelos Flash anteriores están pensados para baja latencia y alto rendimiento. Son ideales para aplicaciones que requieren respuestas muy rápidas o llamadas masivas (por ejemplo, autocompletado ligero, clasificación o servicios de backend con mucho tráfico). Siguen siendo potentes en lenguaje, pero más optimizados para coste y velocidad.

El nivel gratuito establece límites de frecuencia y volumen de uso, medidos principalmente en solicitudes por minuto (RPM), tokens de entrada por minuto (TPM) y solicitudes por día (RPD). Si te pasas de cualquiera de esos umbrales, la API devuelve un error de límite de frecuencia (HTTP 429) indicando cuándo puedes volver a intentarlo.

Conviene tener muy claro que esos topes se aplican por proyecto, no por clave individual. Es decir, aunque generes varias claves dentro del mismo proyecto, comparten la misma cuota gratuita. La cuenta se resetea diariamente a medianoche hora del Pacífico, lo que marca el ciclo natural de consumo para planificar tus cargas de trabajo.

Cómo conseguir una API gratis de Gemini con Google AI Studio

La forma más sencilla de empezar, sobre todo si no quieres pelearte con toda la consola de Google Cloud, es usar Google AI Studio. Esta herramienta web está pensada para experimentar con Gemini, probar prompts, guardar plantillas y, además, generar claves API para tus proyectos.

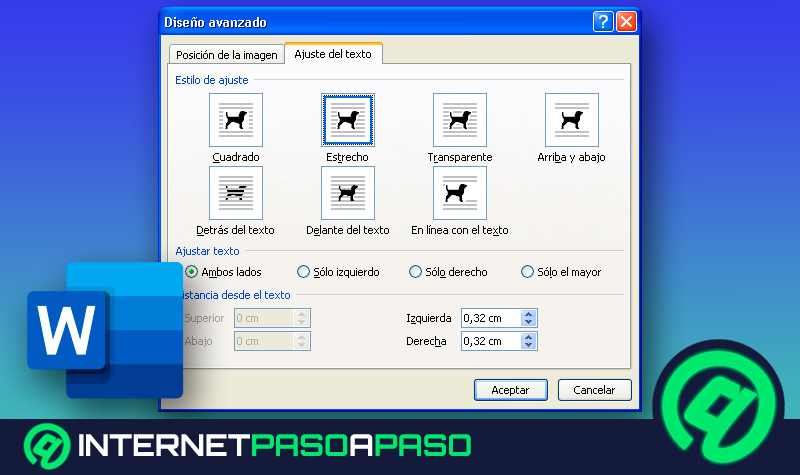

El proceso es bastante directo: primero accedes a aistudio.google.com e inicias sesión con tu cuenta de Google (vale la misma que usas para Gmail). Dentro del panel, en la barra lateral izquierda, verás un enlace llamado algo como “Get API Key” o “Obtener clave de API”, normalmente justo encima de tu nombre o correo.

Al hacer clic, entras en la sección de Claves de API. Desde ahí solo tienes que pulsar en “Crear clave de API” o “Create API key”. El sistema te pedirá asociar esa clave a un proyecto nuevo o a uno ya existente, para que puedas identificar el uso y gestionar las cuotas de manera organizada.

Una vez creado el proyecto, la clave aparecerá en la lista de claves API con su fecha de creación y nivel de cuota asignado. En AI Studio, la clave suele empezar por “AIza…”, y es el código alfanumérico que tendrás que usar en tus peticiones HTTP o SDKs. Debes guardarla en un lugar seguro, como una variable de entorno, y evitar compartirla en público o subirla a repositorios.

Con esa clave puedes empezar a llamar a los endpoints de Gemini desde tus scripts o aplicaciones. Desde AI Studio también puedes generar ejemplos de código en lenguajes como Python o Node.js listos para copiar y pegar, lo que acelera muchísimo las primeras pruebas sin necesidad de profundizar en la documentación desde el minuto uno.

Uso de Google Cloud Platform y otros servicios gratuitos

Si necesitas un control más fino sobre facturación, monitorización y despliegue en producción, puedes activar la API de Gemini directamente en Google Cloud Platform (GCP). Esto implica un par de pasos extra, pero a cambio ganas acceso total al ecosistema de Cloud y a herramientas como Vertex AI.

En la consola de GCP, el flujo típico pasa por crear un proyecto (con un nombre descriptivo y una cuenta de facturación asociada, aunque uses solo el nivel gratuito), luego ir a “API y servicios”, hacer clic en “Habilitar API y servicios” y buscar la API de Gemini correspondiente para activarla en ese proyecto.

Desde la sección de “Credenciales” puedes generar una clave de API clásica de Google Cloud, o bien configurar cuentas de servicio con permisos concretos (por ejemplo, rol de “Usuario de Vertex AI”) para usar autenticación basada en claves JSON con los SDKs oficiales. Esto es lo ideal en entornos backend o cuando trabajas con varios servicios cloud a la vez.

Aparte de Gemini, GCP ofrece un buen número de productos con cuotas gratuitas sin fecha de caducidad. Por ejemplo, primer medio millón de caracteres al mes gratis en algunos servicios de traducción y texto, minutos de audio sin coste en reconocimiento de voz, análisis de imágenes y vídeo con miles de unidades gratuitas al mes, o instancias e2-micro y gigas de almacenamiento en regiones de EE. UU. sin coste mensual.

Esa combinación hace posible montar soluciones híbridas donde Gemini se encarga del razonamiento generativo y otros servicios de Google Cloud gestionan el almacenamiento, la traducción masiva, la detección de contenido o el procesamiento multimedia, todo ello manteniéndose dentro de los límites del nivel gratuito permanente si dimensionas bien las cargas.

Plataformas de terceros: atajos, ventajas y riesgos

Además del acceso directo a través de Google, muchas empresas SaaS ofrecen plataformas de terceros que integran la API de Gemini junto con modelos de otros proveedores como OpenAI, Anthropic o servicios como DeepSeek. El gancho suele ser que con una sola suscripción o cuenta unificada puedes llamar a cientos de modelos diferentes sin gestionar claves por separado.

Estas plataformas suelen facilitar un panel propio, con dashboards de uso, SDKs simplificados, entornos tipo playground y herramientas para crear flujos complejos sin necesidad de saber demasiado de cloud. Servicios como CometAPI, por ejemplo, permiten acceder a Gemini 2.5 Pro desde una misma API multi‑modelo donde también tienes modelos de chat, imagen, vídeo o generación de música.

El lado bueno es que la curva de entrada es muy baja: te registras, obtienes una clave de esa plataforma y empiezas a llamar a Gemini a través de su infraestructura, muchas veces con niveles gratuitos o créditos iniciales generosos. También es frecuente que ofrezcan entornos sandbox o de pruebas donde puedes experimentar sin tocar tu producción.

Sin embargo, usar intermediarios introduce cuestiones de privacidad y gestión de datos. Aunque el proveedor te garantice que respeta tu información, sigues dependiendo de que la API subyacente (en este caso, la de Google) trate esos datos según su propia política. En modelos que solo tienen versión gratuita como algunos Gemini 2.0 Flash o Flash Thinking, hay quien teme que ese uso sin coste implique un entrenamiento más agresivo con las entradas de los usuarios.

Para mitigar riesgos, conviene revisar a fondo la política de datos tanto del tercero como de Google, desactivar el uso de datos para entrenamiento cuando exista esa opción, evitar mandar información extremadamente sensible (datos personales, secretos de negocio muy críticos) y, si es posible, cifrar o anonimizar parte del contenido antes de enviarlo al intermediario.

Privacidad, datos y uso de modelos gratuitos

La preocupación sobre qué hace Google con los datos que pasan por las APIs de Gemini es lógica, sobre todo cuando se trata de modelos de acceso gratuito o funciones en fase de vista previa. Hay desarrolladores que prefieren pagar por las versiones estables (como Gemini 1.5 cuando no eran gratis) porque asumen que así se garantiza un trato más estricto de la privacidad.

En el caso de APIs gratuitas como Gemini 2.0 Flash o Gemini 2.0 Flash Thinking, donde de momento no existen versiones de pago separadas, se abre el debate sobre si Google podría utilizar más intensamente esas interacciones para refinar sus modelos, incluso aunque ciertos intermediarios prometan privacidad total a sus usuarios.

Desde el punto de vista práctico, lo prudente es asumir que cualquier dato enviado a un tercero o a una API en la nube debe tratarse como potencialmente sensible, y actuar en consecuencia: limitar al máximo los datos personales, separar entornos de pruebas de producción y no enviar información que, en caso de filtración, pueda causar un daño serio.

Cuando trabajas a través de proveedores de software externos, una estrategia razonable es configurar tu arquitectura para que esos intermediarios no vean la información más delicada. Por ejemplo, puedes hacer que tu servidor propio pseudonimice o reduzca el contenido antes de mandarlo al tercero, y que solo tu backend tenga acceso a la versión completa de los datos reales.

También es recomendable revisar periódicamente las opciones de privacidad en Google AI Studio y en Google Cloud, ya que Google suele ofrecer ajustes para excluir tus datos de entrenamiento cuando sea posible, así como contratos específicos para organizaciones, educación o investigación donde el tratamiento está más acotado por acuerdo.

Herramientas y productos relacionados con Gemini en modo gratuito

La API de Gemini no vive aislada: Google ha montado alrededor un ecosistema de herramientas gratuitas o con niveles sin coste que amplían lo que puedes hacer sin pagar. Algunas de estas piezas están pensadas para desarrolladores y otras para usuarios finales que no saben programar.

Entre las más destacadas están los entornos de desarrollo y asistentes de programación basados en Gemini. Por ejemplo, hay un IDE centrado en agentes que coordina varios modelos de IA sobre tu base de código, o una interfaz de línea de comandos que integra Gemini directamente en el terminal para automatizar tareas con scripts y subagentes sin salir de tu consola.

Gemini Code Assist, orientado a programadores individuales, se ofrece sin coste económico y sin necesidad de tarjeta de crédito, con límites de uso bastante generosos, incluyendo hasta 180.000 finalizaciones de código al mes. Esto te permite tener autocompletado inteligente, generación y depuración asistida en tus IDEs más usados.

Más allá del código, Google ofrece herramientas como NotebookLM, que funcionan como asistentes personalizados sobre tus propios datos. Puedes crear hasta 100 cuadernos, cada uno con decenas de fuentes, y subir documentos largos (hasta cientos de miles de palabras por fuente) para que la IA te genere resúmenes, respuestas contextualizadas y explicaciones.

Si miras el listado de productos cloud, verás además servicios de traducción en tiempo real, procesamiento de texto, análisis de lenguaje natural, visión por ordenador, vídeo, texto a voz y voz a texto, casi siempre con tramos gratuitos mensuales fijos que no caducan. Son un complemento perfecto a Gemini cuando quieres construir soluciones más completas apoyadas al 100% en la nube de Google.

En conjunto, este ecosistema sin coste hasta ciertos umbrales convierte a Gemini y su API en una opción muy competitiva para freelancers, startups y profesionales independientes que buscan automatizar trabajo y escalar proyectos sin multiplicar los costes de infraestructura desde el primer día.

Con todo lo visto, la combinación de una API gratis de Gemini, límites de uso razonables y un buen puñado de herramientas asociadas hace posible que casi cualquiera pueda experimentar, prototipar e incluso desplegar soluciones serias basadas en IA sin rascarse el bolsillo, siempre que se entienda bien cómo funcionan las cuotas, se cuide la privacidad de los datos y se diseñen los flujos de trabajo con cabeza para exprimir al máximo cada token disponible.

![¿Cuáles son los mejores proxys gratis para navegar de forma anónima por Internet? [year]](https://internetpasoapaso.com/wp-content/uploads/Cuáles-son-los-mejores-proxys-gratis-para-navegar-de-forma-anónima-por-Internet-1.jpg)