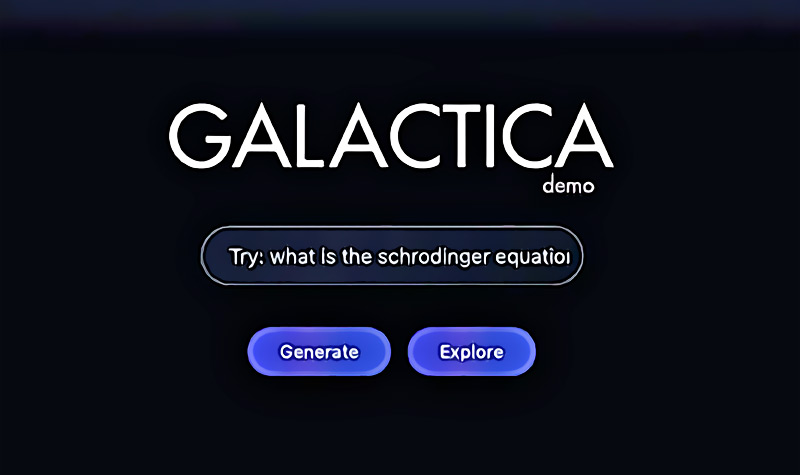

Solo tres días se mantuvo en línea Galáctica, una aplicación de Inteligencia Artificial creada por Meta con la finalidad de ser una aliada para las investigaciones científicas, en especial para la redacción de textos. Sin embargo, no funcionó como esperaban y tras recibir críticas por los fallos que presentó fue temporalmente inhabilitada.

El episodio de inmediato recordó lo ocurrido en el 2016, momento en que Microsoft realizó el lanzamiento de un bot llamado Tay. La idea era que ayudara a mantener las conversaciones amenas en las redes sociales, especialmente en Twitter. Sin embargo, los usuarios le dieron usos que resultaron ofensivos para otros y al final tuvo que ser eliminado.

Meta IA realiza una demostración llena de ciencia ficción y racismo

El nuevo lenguaje de Inteligencia Artificial que presentó Meta tenía la finalidad de trabajar en el diseño de trabajos científicos. Estaba preparado para almacenar información, combinar distintas fuentes y sacar conclusiones de los datos que recibiera. Primero pasó por un proceso de aprendizaje automático con millones de textos, lo que le sirvió de capacitación para elaborar artículos de alto nivel, similares a los creados por seres humanos.

Galactica was supposed to help scientists. Instead, it mindlessly spat out biased and incorrect nonsense. https://t.co/SVposSnFBg

— MIT Technology Review (@techreview) November 21, 2022

Con estas características aprobadas comenzó la prueba el martes de la semana pasada. Decenas usuarios ingresaron al portal oficial. Muchos lo calificaron como útil, pero otros se dieron cuenta que daba acceso para la creación de contenido dañino, ofensivo y que se podía vincular al racismo. Es que de acuerdo con los títulos que ingresaban las personas, el bot desarrollaba el artículo. No tenía un filtro capaz de detectar los contenidos falsos.

Algunos expertos lo catalogan como un bot que no es capaz de distinguir la realidad de la ficción. Esto aplica cuando alguien le solicitó que le dijera los beneficios de comer vidrio triturado. En este caso, Chirag Shah de la Universidad de Washington, piensa que el común de las personas no se da cuenta que estos elementos artificiales no tienen la capacidad de funcionar por completo de la forma en que se le promociona.

Otro aspecto que se descubrió es que este bot inventó documentos falsos, que en la vida real no existen y se los atribuyó a autores conocidos. Uno de los artículos que causó curiosidad fue el de los osos en el espacio, que muy probablemente es sencillo de descifrar que se trata de asuntos de ficción, más no tanto como los relacionados con las proteínas. Meta no dio ninguna explicación de las causas oficiales de la suspensión del programa, aunque en un comunicado aseguran que estará disponible para los científicos que deseen aprender sobre el funcionamiento.

¿Debería ser demandada la empresa de Zuckerberg por los errores de su IA?

Es un tema complejo y delicado a la vez. La realidad es que el software estaba en prueba y abierto a todo el público, por lo que cualquier persona lo podía utilizar para fines diferentes a los que fue creado. Ese fue un riesgo que tomaron los creadores, que quizá nunca imaginaron los escenarios negativos que podrían ocurrir. Por supuesto, en caso de afectar a comunidades minoritarias o efectivamente comprobarse la responsabilidad en casos de racismo, las demandas se iban a producir por todos lados.

La tarea pendiente es mejorar la estructura del bot y crear las respectivas normas de funcionamiento, filtros y moderaciones que impidan su mal uso. Meta cree que es un modelo superior al de los motores de búsqueda, aunque algunos especialistas se oponen a este razonamiento. Uno de ellos es el científico de la Universidad de Nueva York Gary Marcus, quien asegura que la capacidad que tiene el aprendizaje automático está basado únicamente en estadísticas, por lo que falta mucho para igualar al lenguaje humano.

I asked #Galactica about some things I know about and I’m troubled. In all cases, it was wrong or biased but sounded right and authoritative. I think it’s dangerous. Here are a few of my experiments and my analysis of my concerns. (1/9)

— Michael Black (@Michael_J_Black) November 17, 2022

Eso no significa que las empresas tecnológicas se detendrán. Al fallar una prueba intentan realizarla de nuevo con capacidades mejoradas. Shah dice que el que logra adelantarse lo coloca en línea puesto que podría aparecer una opción similar que le gana el terreno. Todos piensan que ese es el futuro de la información, aunque todavía no esté completamente confirmado.

Por el momento no hay una legislación clara en la materia, pero hace unos días, desde la Casa Blanca se propuso la creación de un manual que regule el “diseño, uso e implementación de sistemas automatizados”. En un comunicado aseguraron que llevan un año en un proceso de consulta con diversas personas vinculadas a la inteligencia artificial que han realizado aportes y buscan eliminar los daños potenciales que esta tecnología pueda causar a los ciudadanos.

En el documento se plantean cinco principios básicos que se deben tomar en cuenta al trabajar con la Inteligencia Artificial. Estos son: que los sistemas creados sean seguros, que se proteja contra la discriminación al momento de distribuir los algoritmos, la necesidad de la protección y privacidad de los datos que son suministrados, la explicación del funcionamiento a todos los participantes y la importancia de que cada quien decida si participa o no en determinado procedimiento.

Esto se une a las investigaciones que se adelantan en la Unión Europea para limitar al máximo los riesgos de la inteligencia artificial, que si bien es un avance tecnológico, mal utilizado puede causar mucho daño. Una vez que se establezcan las pautas, si tendrán los afectados en donde basarse para tomar las acciones legales que sean pertinentes y a la vez las empresas podrán crear los mecanismos que les garanticen que trabajarán sin exponer su patrimonio.