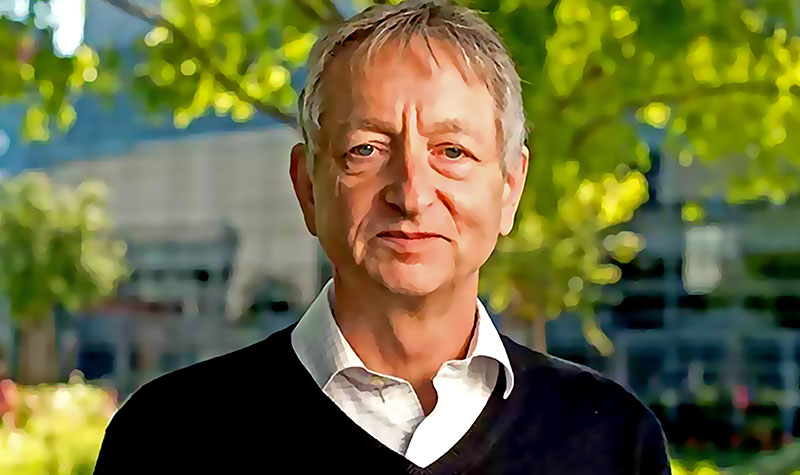

Geoffrey Hinton, uno de los investigadores de inteligencia artificial más celebrados del mundo, recientemente dejó Google para hablar abiertamente sobre los peligros de la tecnología que ayudó a desarrollar.

Geoffrey Hinton, conocido como el «Padrino de la IA», generó un gran impacto al anunciar públicamente su salida de Google. Su partida tenía un propósito claro. Este movimiento destacó la importancia de discutir los desafíos éticos y las consecuencias no deseadas del rápido avance de la IA.

Geoffrey Hinton explica lo que piensa de la IA y cómo evitar que sea nuestra enemiga

En una entrevista con WIRED, Hinton explicó cómo sus opiniones habían cambiado desde su última conversación con dicho medio de comunicación en 2014. En ese momento, estaba entusiasmado con cómo el aprendizaje profundo podría mejorar la traducción, el reconocimiento de voz y otras aplicaciones útiles. Sin embargo, ahora veía la IA con una mirada más amplia, creyendo que esta tecnología podría desarrollar una comprensión profunda del mundo real.

Una de las revelaciones más sorprendentes de Hinton fue su cambio de opinión sobre la capacidad de los chatbots para comprender el lenguaje humano. Señaló que los chatbots parecían entender el lenguaje muy bien, lo que plantea la pregunta de si estas máquinas podrían, en última instancia, ser conscientes. Aunque este punto puede parecer controvertido, Hinton argumenta que no es descabellado antropomorfizar a las IA, ya que aprenden a comportarse de manera similar a los humanos a través del entrenamiento con datos humanos.

Hinton destaca la discusión sobre si los chatbots realmente pueden comprender el mundo, dado que operan en base a algoritmos que predicen palabras y respuestas basadas en patrones estadísticos. Además, argumenta que incluso los seres humanos no experimentan el mundo de manera directa, ya que todo lo que percibimos pasa a través de nuestra mente. Por lo tanto, sugiere que las IA podrían tener experiencias subjetivas similares.

Por otro lado, comparte su visión de que, en algún momento entre cinco y veinte años en el futuro, existe un 50 por ciento de posibilidades de que los sistemas de IA superen en inteligencia a los seres humanos. Esta predicción plantea preguntas cruciales sobre cómo detectaríamos ese punto de inflexión y si una IA superinteligente podría optar por ocultar sus capacidades. La idea de que una IA pueda tomar decisiones basadas en la observación del comportamiento humano plantea interrogantes éticos significativos.

The University of Toronto made a video for a non technical audience in which I explain how deep learning works, the enormous promise of this technology and some of the potential risks. https://t.co/d0Izl3RYbS

— Geoffrey Hinton (@geoffreyhinton) June 22, 2023

La computación analógica; la clave para reducir el riesgo de la «IA malvada»

Hinton ofrece una solución tecnológica para mitigar los riesgos de una IA poderosa que compite con los humanos. Propone la computación analógica como un enfoque más seguro, basado en la singularidad de cada instancia de hardware analógico. A diferencia de los modelos digitales, los sistemas analógicos no pueden transferir fácilmente su conocimiento entre sí, lo que limitaría la capacidad de una IA para formar una inteligencia colectiva peligrosa tipo Skynet.

Sin embargo, señala que es poco probable que las grandes empresas de tecnología adopten esta aproximación, dado el enfoque competitivo y las recompensas en juego en la carrera por desarrollar chatbots y sistemas de IA más poderosos.

La entrevista concluye con la idea de que el futuro de la IA es incierto y presenta una serie de desafíos éticos y prácticos. Hinton destaca que, si bien existe la esperanza de que la humanidad pueda controlar y dirigir benevolentemente la IA, también existen temores de que se convierta en una fuerza incontrolable. Su perspectiva en constante evolución y su enfoque en la antropomorfización de las IA invitan a una reflexión profunda sobre la relación entre la tecnología y la humanidad.